��������DeepSeek�����AIѵ���ɱ�����½����Լ�������Token�ɱ������AI�����Լ�����ʽAI������������и�ҵ��������������Meta�Լ���˹�����������Ƽ���ͷ�ǵĻ�Ӧ���������Ƿ���̾��DeepSeek�Ĵ��£�����δ��˶�ҡ���ģͶ��AI�ľ��ġ�������ΪDeepSeek������¼���·����������AI�ɱ��������½�̬�ƣ�����AIӦ�ö���˵����Ȼ���ڸ���Ļ�����ģ��ö��AIӦ������������������

��������2025��֧���ƻ�������ѷ������Ԥ�ƽ��ﵽ1000����Ԫ����������ѷ��ΪDeepSeek��ճ�����ζ��δ��������AI������������ţ���˼Ӵ�֧��֧��AIҵ��չ����ϯִ�йټ�����ʾ��“���Dz�����û�п������������źŵ�����½��вɹ�����AWS�������ʱ�֧��������������AI����ǧ���ѷ����ҵ������ʱ������Ϊ���AWSҵ����г��ڷ�չ��һ���൱�õ��źš�”

���������ܣ��ȸ衢����Meta�������ͷ������˹���������Ͷ����ʽ𡣾�������DeepSeek�������ĵͳɱ�����������Ƽ���ͷ�Ǽ��ţ����ģͶ�ʽ�Ϊδ���ޱ��Ӵ��������AI��������춨�ش������

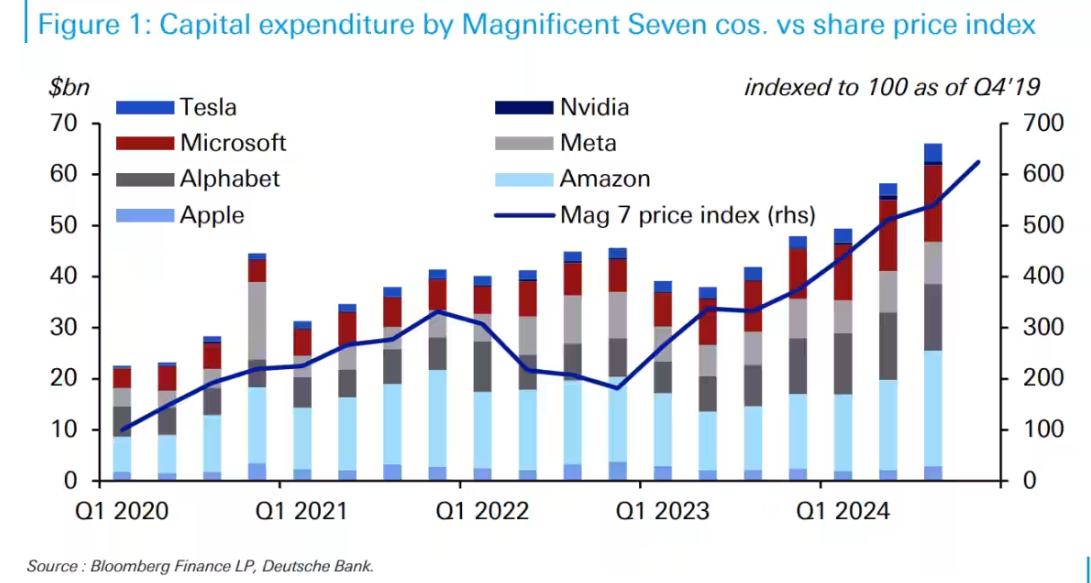

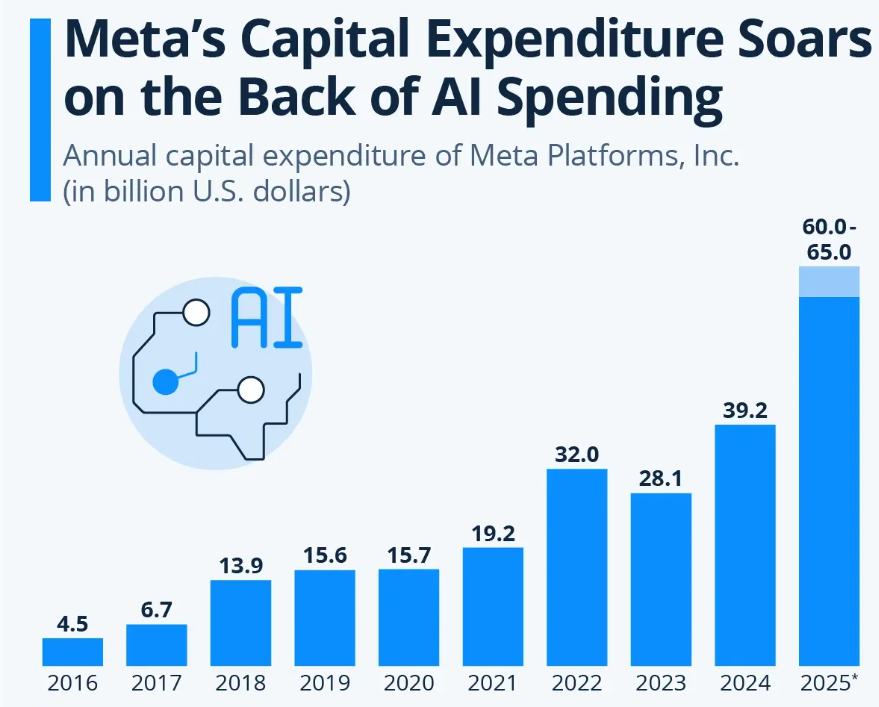

��������Visible Alpha��Ԥ�⣬��2025����ʱ�֧��Ԥ�ƽ�����900����Ԫ��ռ��Ӫ�յ�30%���ϡ�Facebookĸ��˾MetaҲ�������Ͷ�ʼƻ���Meta��������ƻ���2025���ʱ�֧�����60%���ϣ���ߴ�650����Ԫ��ͬ��ռ��Ӫ�յ�30%���ϣ��ƻ��������˹�����������ص���Ŀ����ζ�ż�2024������Ǯ��380����ԪͶ���˹����ܵ���ǰ�ؿƼ�����֮��Meta���꽫�������ؽ���벼��AI���ȸ�ƻ�2025��Ͷ��750����Ԫ������AI����Ŀ��ص��ʱ�֧������ȥ��525����Ԫ��֧�����������Զ���ڹ�ȥʮ��ƽ������13%��ˮƽ��

�����г���ʼ���ۿƼ�����“��Ǯ��”�����Ӯ�ң�AI ASIC

�������������Ƽ���ͷ�Ǽᶨ���˹����������Ҿ��ʣ���������Ӯ����������������AI ASIC��ͷ——��ͨ��Marvell��ƾ����оƬ�以��ͨ���Լ�оƬ�����ݸ��ٴ�������ļ����쵼��λ����������ͨ��Marvell��AI ASIC�г������������

������������ѷ���ȸ��Լ�Meta����������ʽAI�����OpenAI����һ���ⶼ�����ֲ�ͨ����Marvell����AI ASICоƬ�����ں���������AI�����������AI ASICδ���г��ݶ�����֮���������ǿ��AI GPU���������ڷݶ�Եȣ������ǵ�ǰAI GPUһ�Ҷ������——ռ��AIоƬ����ߴ�90%�ݶ��Ҳ��Ϊ�ν��ղ�ͨ��Marvell�ɼ�����ǿ��Ӣΰ����AMD��

����Ħ��ʿ�������շ������б���ʾ��AI ASIC�г���ģ����2024���120����Ԫ������2027���300����Ԫ���긴�������ʴﵽ34%��������Ħ��ʾ��AI ASIC��������ζ��Ӣΰ��AI GPUǰ������ʽ�»����û�����Ϊ������оƬ��ϵ�����ڹ��棬Ϊ�ն������ṩ����������ƵĽ����������һ�����ִ��л����ʾ��AI ASIC���տ��ܸ����������������أ�����������AI�����������ӣ�AI ASIC�г��ݶ��������

�������⣬��Ħͨ��TCOģ�ͶԱ���AI ASIC��AI GPU��AIѵ�������������еijɱ�Ч�棬�����ʾASIC�ij�ʼ�ɱ��ϵͣ������ʺ�Ԥ�������Ʒ����ṩ���ǣ���˴�Ħ���ò�ͨ��Marvell�ɼ�ǰ������Ϊ����������“DeepSeek�����”����������������������

�����ڹȸ���Metaҵ���绰�����ϣ�Ƥ�����Լ����˲������ʾ���Ӵ�����Я��оƬ���̲�ͨ�Ƴ�����AI ASIC���������ͷ��AI ASIC����������鶼�Ƕ��ƻ�оƬ��������߲�ͨ������ȸ����ֲ�ͨ�����TPU(Tensor Processing Unit)����һ������͵�AI ASIC��Meta��ǰ�벩ͨ��ͬ�����Meta�ĵ�һ���͵ڶ���AIѵ��/�������ٴ�������Ԥ��Meta�벩ͨ����2025��ӿ��з�Meta��һ��AIоƬ MTIA 3���������Ͷ���Լ������Ⱥ�����OpenAIȥ��10�±�ʾ����Я�ֲ�ͨ����OpenAI��AI ASICоƬ��

��������ѷ���������ʾ���Ը����ģ������AI ASIC����������ʩ��MarvellΪ����ѷAWSAI ASIC����������飬ȥ��12��Marvell����ͬ����ѷAWS���һ��Ϊ�������Э�飬��һ����չAI ASICս�Ժ�����ϵ��Marvell����5����Я������ѷ�Ƴ������������AIоƬ��Ʒ��

����չ��δ��AI����ǰ����DeepSeek R1��ճ���Ҳ�ذ���������ѵ��/��������“����ѹ��+��Чǿ��ѵ��+AI�������������”�ĵͳɱ��·�ʽ������AI ASIC��ʱ�����١�DeepSeek R1�ذ���¯֮��ȫ��Ƽ���Ͷ�����Լ��Ƴ�AI�ĿƼ����˿�Ƕ���Ӣΰ�������AI GPU(Hopper�ܹ���Blackwell�ܹ�GPU)��������ν�����ش��Ѻۣ�Ͷ�����Dz������ɣ��������ֲ�ͨ/Marvell�Ƴ�����AI ASIC(�����ƻ�AIоƬ)�����Լ۱ȸߵö�?

�������Ŵ�ģ�ͼܹ������ֳ��췶ʽ����(��������� Transformer ��������Diffusion ģ����ˮ��)��ASIC���Ը����س��������������������ء�����ijЩ�Ʒ����̻���ҵ��ͷ������������ջ���� ASIC���ݳ������������ӣ����ṩ����Ŀ����߹��ߣ��⽫���� ASIC �����ڳ�̬��/�����������е��ռ���

����չ��δ������ǰ����Ӣΰ��AI GPU���ܸ���רע�ڳ����ģǰ��̽���Ե�ѵ�����仯����Ķ�ģ̬���½ṹ�������飬�Լ� HPC��ͼ����Ⱦ�����ӷ�����ͨ��������AI ASIC��۽������ѧϰ�ض�����/�������������Ż���Ҳ�����ó��ȶ��ṹ������������ͨ��������Ч�ȡ����磬���һ����ƽ̨��AI���������д���ʹ����� CNN/Transformer �г�������(�������˷���������LayerNorm��Attention��)�����AI ASIC�������Щ��������ȶ���;ͼ��ʶ��(ResNetϵ�С�ViT)������Transformer���Զ�����ʶ��(Transformer ASR)��Transformer Decoder-only�����ֶ�ģ̬��ˮ�߹̶��������Ի���ASIC���м����Ż���

����ASICͨ�������������ܹ� (Dataflow) ������������Ԫ�ȷ�ʽ���Ծ���˷����������������ע������Ƚ��и߶��Ż���һ��ijЩ��ģ�ͼܹ������ó����������ȶ������������������������ASIC��ר�ö���Ӳ�����Խ���λ�ܺ��뵥λ�ɱ������������ͨ�� GPU(ͨ���ɴ� 2~10 ��������Ч����)���������������Խ��Խ�۽��ɱ�����Ч��AI ASIC �߱������ģ������ǰ�����ر�����������ṹ�̻��ij�̬����������AI���������ϡ�

���������ĦԤ�����������Զ���������߽���г���棬��������AI ASIC�г��ݶ�����������š�Ӣΰ��ͨ��GPU���۽��ڸ��Ӷ�䳡����ǰ���о���ASIC �۽���Ƶ�ȶ������ģ��AI���������Լ�һ���ֳ����ȶ��Ĺ̻�ѵ�����̡�

������Դ����ͨ�ƾ�APP

��2ҳ ��һҳ [1] [2]